本文系网易新闻•网易号特色内容激励计划签约账号【智东西】原创内容,未经账号授权,禁止随意转载。

编译 | 香草

编辑 |李水青

一直以来,AI能否拥有“意识”的话题受到公众和科学界的广泛关注。科幻小说或影视作品中,也时常出现AI具有意识的描写或画面。在1968年的电影《2001太空漫游》里,名为HAL9000的超级计算机产生了自我意识,并为了完成自己的目的而反抗人类指令。

随着AI相关技术的飞速发展,其具有意识的观点似乎越来越不像是天马行空。去年,OpenAI首席科学家伊利亚·苏特斯科夫(Ilya Sutskever)在其社交媒体上称,现在的大型神经网络可能具有“轻微的意识”。

▲苏特斯科夫推文截图

目前,大部分研究人员认为AI还没有发展到具有意识的程度。但其进化速度也让人们开始思考:如果AI有了意识,我们该如何知晓?

近日,一个由19位神经科学家、哲学家以及计算机科学家组成的团队发表论文,依据6种科学理论提出了一个判断AI是否具有意识的指标属性清单。该团队认为,一个系统符合的指标条数越多,就表明其具有意识的可能性越高。

作者认为,该论文的主要贡献有三点:

1、证明对AI中的意识进行评估在科学上是可行的,意识可以通过科学的方法进行研究,而且研究结果适用于AI;

2、提出一个评估AI意识的标准,其形式是一份从科学理论中得出的指标属性清单;

3、提供初步证据表明,尽管目前的系统似乎都不是意识的有力候选者,但AI系统可以利用现有技术实现许多指标属性。

▲作者认为该论文的三点贡献

一、明确“意识”的含义,三个假设判断AI是否有意识

在判断AI是否具有意识之前,首先要明确“意识”的含义。论文作者之一、加州大学欧文分校认知科学系的梅根·彼得斯(Megan A. K. Peters)称,他们将重点放在了“现象意识”(Phenomenal consciousness),也就是所谓的主观体验上。当我们说一个人、动物或AI系统有意识时,这是指他们目前正在进行有意识的体验,或者说他们能够进行有意识的体验。

有许多基于神经科学的理论描述了意识的生物学基础,但其中哪一种才是“正确”的,目前科学界还没有达成共识。因此,作者综合使用了一系列这些理论来创建自己的框架。他们的想法是,如果一个AI系统的运行方式符合其中许多理论的某些方面,那么它就更有可能是有意识的。

他们认为,比起询问ChatGPT是否具有意识等简单的测试,使用神经科学的理论来评估更合适一些。毕竟,AI系统在模仿人类方面已经非常出色,对意识相关的问题也可能有设置好的答案方向。

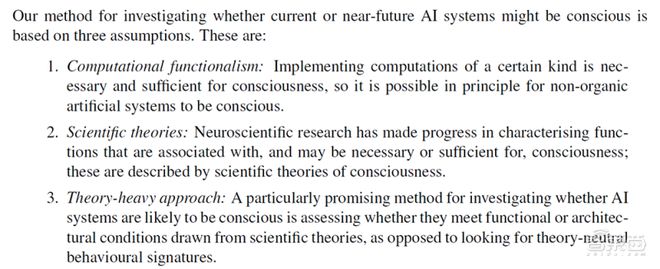

在该论文中,作者研究当前或将来的AI系统是否有意识的方法主要基于三个假设,分别是计算功能主义、科学理论以及重理论(Theory-heavy)方法。论文对三个假设作了分别的介绍:

1、计算功能主义:能够实现某种计算是AI系统具有意识的充分必要条件,因此非有机人工系统原则上是可能具有意识的。

2、科学理论:神经科学的研究在意识存在的必要和充分条件方面取得了进展,研究将基于这些神经科学理论展开。

3、重理论(theory-heavy)的方法:研究AI系统是否可能有意识的一种方法,是去评估它们是否符合科学理论中的功能或架构条件,而不是寻找某些具体的行为特征。

▲论文提出三个假设

二、从6种科学理论中,提取出14条意识判断指标

基于第2条假设,作者选择了6种基础理论,并结合其他两条假设,从中提取了一系列共14条意识指标。

这6种理论分别是:循环处理理论(Recurrent Processing Theory,RPT)、全局工作空间理论(Global Workspace Theory,GWT)、高阶理论(Higher-Order Theories,HOT)、注意力基模理论(Attention Schema Theory,AST)、预测处理(Predictive Processing,PP)和能动性与具身化(Agency and Embodiment,AE),论文着重介绍了其中的前3种理论。

▲该论文基于6种理论提出14条指标(图源:论文插图,智东西译制)

1、循环处理理论(RPT)

RPT是一种视觉意识理论,提出无意识状态与有意识状态对应于视觉加工的不同阶段。该理论认为,无论前馈扫描到达大脑的哪个区域,它本身都不会产生意识体验;意识体验的必要条件,是视觉区域的神经元参与所谓的循环处理。

基于RPT,作者提出2条指标,分别是:RPT-1,输入模块使用算法循环;RPT-2,输入模块生成有组织、整合的感知表示。符合这两条指标表明AI系统能够循环处理视觉输入,整合特征并组织生成有意义的视觉场景。

2、全局工作空间理论(GWT)

GWT是一种意识模型,指的是可以将专业模块网络中的信息进行整合和分发,以创建更高级的认知和意识形式的大规模系统。该理论提出,将大脑分为执行不同功能的专用模块,模块与模块之间具有长距离连接。通过注意选择的过程确定输入或任务要求后,专用模块内的信息可以在不同模块之间传播与共享。

基于GWT,作者提出4条指标,分别是:GWT-1,能够并行运作多个专业模块;GWT-2,工作空间容量有限,造成信息流瓶颈和选择性关注机制;GWT-3,向所有模块提供工作区信息;GWT-4,状态依赖的注意力机制,可以顺序调动模块完成复杂任务。

3、高阶理论(HOT)

HOT是关于意识的一个重要理论流派,提出如果一种心理状态是有意识的,那么主体就会意识到自己处于这种状态。例如,红苹果的视觉表征是一种一阶心理状态,而意识到自己拥有红苹果的表征则是一种高阶心理状态。HOT包含多种理论,该论文主要讨论感知现实监测理论(PRM),其核心观点是,意识取决于一种将知觉系统中的平均活动与噪声区分开来的机制。

基于HOT,作者提出4条指标,分别是:HOT-1,具有生成式、从宏观到微观(Top-down)或带噪声的感知模块;HOT-2,元认知监测区分可靠感知和噪声;HOT-3,一般信念形成和行动选择系统,依据元认知监测结果更新信念;HOT-4,生成“质量空间”的稀疏平滑编码。

4、其他理论

基于其他3种理论提出的指标分别为:AST-1,可代表并控制当前注意力状态的预测模型;PP-1,输入模块使用预测编码;AE-1能动性,从反馈中学习并选择输出,以追求目标,特别是在涉及对竞争目标做出灵活反应的情况下;AE-2具身化,建立输出-输入应急模型,包括一些系统效应,并在感知或控制中使用该模型。

三、目前AI并没有意识,然而AI的意识不应被低估或高估

在完成指标的制定后,作者对GPT-4、GPT-3、LaMDA、PaLM-E等市面上的大模型,根据GWT和AE指标进行了测试。

首先,作者测试了基于Transformer和Perceiver的大模型对GWT指标的满足情况。

实践表明,基于Transformer的大模型,如GPT-3、GPT-4、LaDMA等,具有GWT-1至GWT-3的指标属性,即它们具有并行模块、引入瓶颈的有限容量工作区和全局广播;但是否满足GWT-4则有待商榷。而Perceiver架构比起Transformer架构更接近于满足GWT指标,但作者仍然认为它无法满足所有指标。

在涉及能动性和具身化的AE指标上,作者测试了被描述为“具身多模态语言模型”的PaLM-E、通过RL训练得到的“虚拟啮齿动物”以及基于Transformer的大型RL训练得到的“自适应主体”AdA模型。

实践表明,AdA模型是三个模型中最接近这两条指标的,但仍被认为无法满足所有指标。

▲PaLM-E的结构(图源:论文插图)

在论文的最后一节,作者讨论了关于AI具有意识的风险问题。他们认为,对AI系统的意识归因不足和过度均具有一定的风险。

如果低估了AI的意识,可能会造成类似于虐待动物的道德风险,导致许多有意识的“生命”承受不必要的痛苦。

而如果高估了AI的意识,可能会错误地优先考虑AI系统的感知利益,导致资源分配失调。此外,还有可能会导致对AI意识的归因分散解决其他紧迫问题的精力、使用错误地方式训练AI,或是干扰有价值的人机关系。

结语:了解意识科学帮助人们更好地应对未来可能的AI意识

在探索AI意识的过程中,人们不仅需要从科技的角度去理解其原理和实现,也需要考虑伦理、道德、法律等问题。虽然目前为止,还没有满足评价指标的AI系统出现,但论文作者也提到,如果计算功能主义是正确的,那么有意识的人工智能系统可以在短期内建立起来。

无论有意识的AI是否出现,能够模仿人类对话的大语言模型系统的兴起,也许会让许多人相信某些AI系统是有意识的。更好地了解意识科学及其对AI的影响,能帮助人们更好地应对这些可能的变化。作者提出这些指标的目的,时通过提供主流的跨学科视角来促进对这些主题的理解,从而说明有关AI意识的问题在多大程度上具有科学可操作性,并可作为未来研究的基础。

来源:Nature